Anonymisation locale et sécurisée

Mes données sont-elles vraiment protégées ? Absolument. Contrairement aux versions web classiques, notre module d’anonymisation traite vos textes localement sur votre ordinateur. Les noms, emails et chiffres sensibles sont remplacés par des balises avant même d’atteindre l’IA. Rien de privé ne quitte votre machine.

Nettoyage Intelligent

L’IA sans compromis sur votre vie privée et vos données personnelles.

Les grandes sociétés (banques, assurances, santé, tech) utilisent des méthodes très structurées pour protéger leurs secrets et les données de leurs clients. Ce n’est jamais du « bricolage », c’est un processus appelé DLP (Data Loss Prevention) ou Désidentification.

Le Masquage et la Substitution (Redaction)

C’est la méthode visuelle la plus courante pour les documents PDF ou Word.

-

Masquage : On remplace les caractères par des symboles (ex:

****-****-1234). -

Substitution : On remplace un vrai nom par un faux nom crédible (ex: « Société X » devient « Entreprise Partenaire »). Cela permet à l’IA (l’IA Gemini) de garder la structure grammaticale de la phrase pour mieux la comprendre sans connaître l’identité réelle.

La Confidentialité Différentielle (Differential Privacy)

(Utilisée par Apple et Google)

-

Le concept : On ajoute un « bruit » mathématique aux données.

-

Exemple : Si un document contient des chiffres financiers ultra-précis, on les modifie légèrement de manière aléatoire. L’IA peut toujours analyser les tendances (ex: « le budget augmente »), mais elle ne connaît jamais le chiffre exact à l’euro près.

L'Anonymisation "Edge" (Locale) Global Universe IA

-

La méthode : Les grandes entreprises interdisent souvent ChatGPT car les données partent sur les serveurs d’OpenAI. Elles préfèrent des solutions qui traitent les données avant qu’elles ne quittent l’ordinateur de l’employé.

-

Argument pour toi : Notre logiciel Global Universe IA agit comme un « filtre de sécurité » local. Rien ne sort du PC tant que ce n’est pas « nettoyé ».

DLP (Data Loss Prevention) ou Désidentification

Nous avons créé Global Universe IA avec une conviction simple : la puissance de l’intelligence artificielle ne devrait jamais se faire au détriment de votre sécurité. Dans un monde où chaque donnée partagée en ligne est aspirée par des serveurs tiers, notre suite logicielle redonne le contrôle aux utilisateurs. Grâce à notre technologie d’anonymisation locale, vous bénéficiez du meilleur de l’IA (Gemini 3.0 et 3 Pro) tout en protégeant vos secrets industriels, vos documents clients et votre identité. »

| Critère | Méthode Classique (Manuelle) | Global Universe IA |

| Temps | Très long (relecture humaine) | Instantané (Scan IA) |

| Risque | Oubli d’une donnée sensible | Détection automatique exhaustive |

| Coût | Heures de travail salarié | Licence unique |

| Sécurité | Erreur humaine possible | Processus standardisé et local |

Simplicité d’adoption pour tous les collaborateurs

Global Universe IA n’est pas juste un logiciel, c’est votre assurance anti-amende RGPD. Il vous permet de profiter de la puissance de l’IA et du partage de données, tout en garantissant que vos informations sensibles ne quittent jamais votre périmètre de sécurité.

Le RGPD échoue souvent car les outils sont trop complexes.

-

L’argument : « Pas besoin d’être un expert en cybersécurité. L’interface intuitive permet aux RH, aux juristes et aux commerciaux de sécuriser eux-mêmes leurs documents en quelques clics. »

-

Pourquoi c’est vital pour le RGPD : La conformité doit être l’affaire de tous, pas seulement du service informatique. Votre outil démocratise la sécurité des données.

Je n’ai plus peur que mes données soient utilisées par l’IA

L’IA sans compromis sur votre vie privée.

TPE et PME s’interrogent souvent sur la conformité de l’IA

IA Générative en TPE/PME : Voici les règles essentielles à connaître pour vous lancer sereinement.

Comment intégrer un LLM sans sacrifier le RGPD ?

L’adoption des modèles de langage (LLM) comme Gemini, ChatGPT, Claude ou Mistral représente un levier de productivité indéniable pour les TPE et PME.

Cependant, pour une petite structure, l’enthousiasme technologique se heurte souvent à une barrière juridique majeure : le Règlement Général sur la Protection des Données (RGPD).

Intégrer une intelligence artificielle générative ne s’improvise pas. Cela nécessite de concilier innovation et conformité pour éviter que vos données sensibles – ou celles de vos clients – ne se retrouvent dans la nature.

Identifier les risques spécifiques aux LLM :

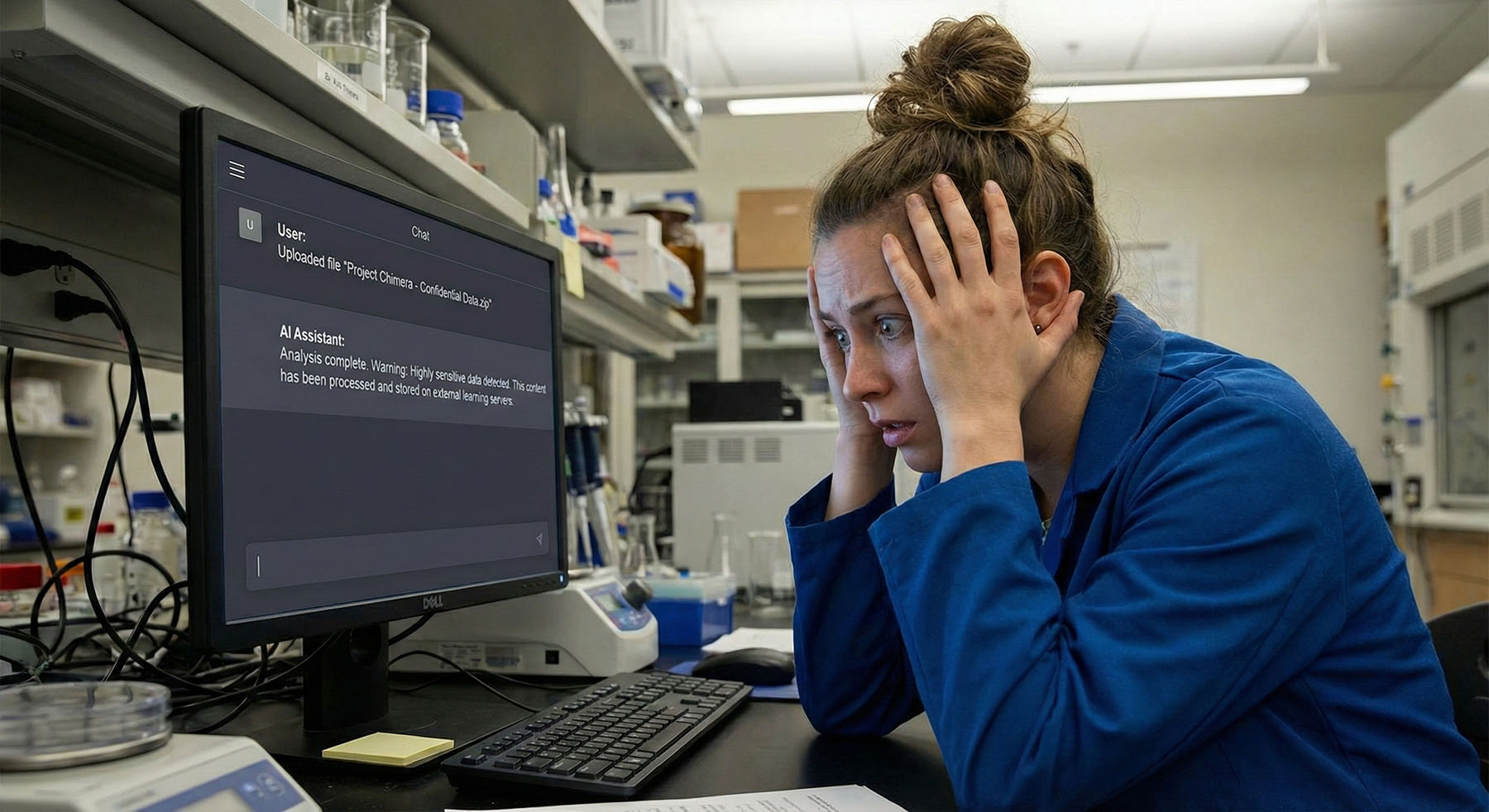

Avant tout déploiement, il est crucial de comprendre que les LLM fonctionnent sur l’ingestion massive de données. Le risque principal pour une PME réside dans le réapprentissage du modèle.

Si vous utilisez une version publique et gratuite d’un outil d’IA, les informations que vous saisissez dans le « prompt » (la commande) peuvent être utilisées par l’éditeur pour entraîner les futures versions de son IA.

Concrètement, si un collaborateur copie-colle un fichier client ou un contrat confidentiel pour en demander un résumé, ces données personnelles quittent le périmètre sécurisé de l’entreprise.

Au regard du RGPD, cela constitue potentiellement une violation de la confidentialité et un transfert de données hors de l’UE non maîtrisé, surtout si les serveurs sont situés aux États-Unis.

Les étapes clés de la mise en conformité :

L’intégration d’un LLM doit suivre une procédure rigoureuse pour satisfaire aux exigences de la CNIL et des régulateurs européens :

·L’Analyse d’Impact (AIPD) : Avant le lancement, il est impératif d’évaluer les risques. Quelles données seront traitées ? Qui y a accès ? Quels sont les risques pour les personnes concernées en cas de fuite ?

·La minimisation des données : C’est une règle d’or du RGPD. N’envoyez à l’IA que ce qui est strictement nécessaire. Il faut privilégier l’anonymisation ou la pseudonymisation des données dans les prompts. Par exemple, remplacez « Monsieur Dupont, né le 12/05/1980 » par « Client A, 43 ans« .

Utilisez des logiciels tels que Global Universe IA, c’est votre assurance contre les amendes RGPD.

·La transparence et l’information : Si vous utilisez un chatbot alimenté par IA pour interagir avec vos clients, vous avez l’obligation légale de les informer qu’ils discutent avec une machine.

De même, vos employés doivent être notifiés de l’usage de ces outils dans leurs processus de travail.

L’arrivée prochaine de l’AI Act européen viendra d’ailleurs renforcer ces obligations, classant certains usages de l’IA selon leur niveau de risque, anticiper ces règles dès aujourd’hui est un investissement stratégique.